|

导读:Google又化身用户体验的游戏规则改变者,ScreenAI。

Google 在近期刚才推出了一项突破性的创新:ScreenAI。

这项技术足够让人兴奋。正如大众所预想的,这项技术有可能重塑用户体验 (UX) 的将来。以下,将是一个全面的制品与技术概述,它可保证你处在技术领先地位。

什么是ScreenAI?

ScreenAI 不是普通的人工智能。这是由于 Google AI 的天才们发明的视觉语言模型 (VLM)。它的与众区别之处,在于它能够理解用户界面 (UI) 和信息图表。

这可能是一个游戏规则的改变者。

这个奇迹不仅是一匹只会一招的小马。它能够执行多种任务,从图形问答到元素注释、摘要、导航和特定于 UI 的 QA。

大众想象一下,人工智能能够像经验丰富的专业人士同样浏览网站或应用程序,一路回答问题并总结内容。

它是怎样运作的?

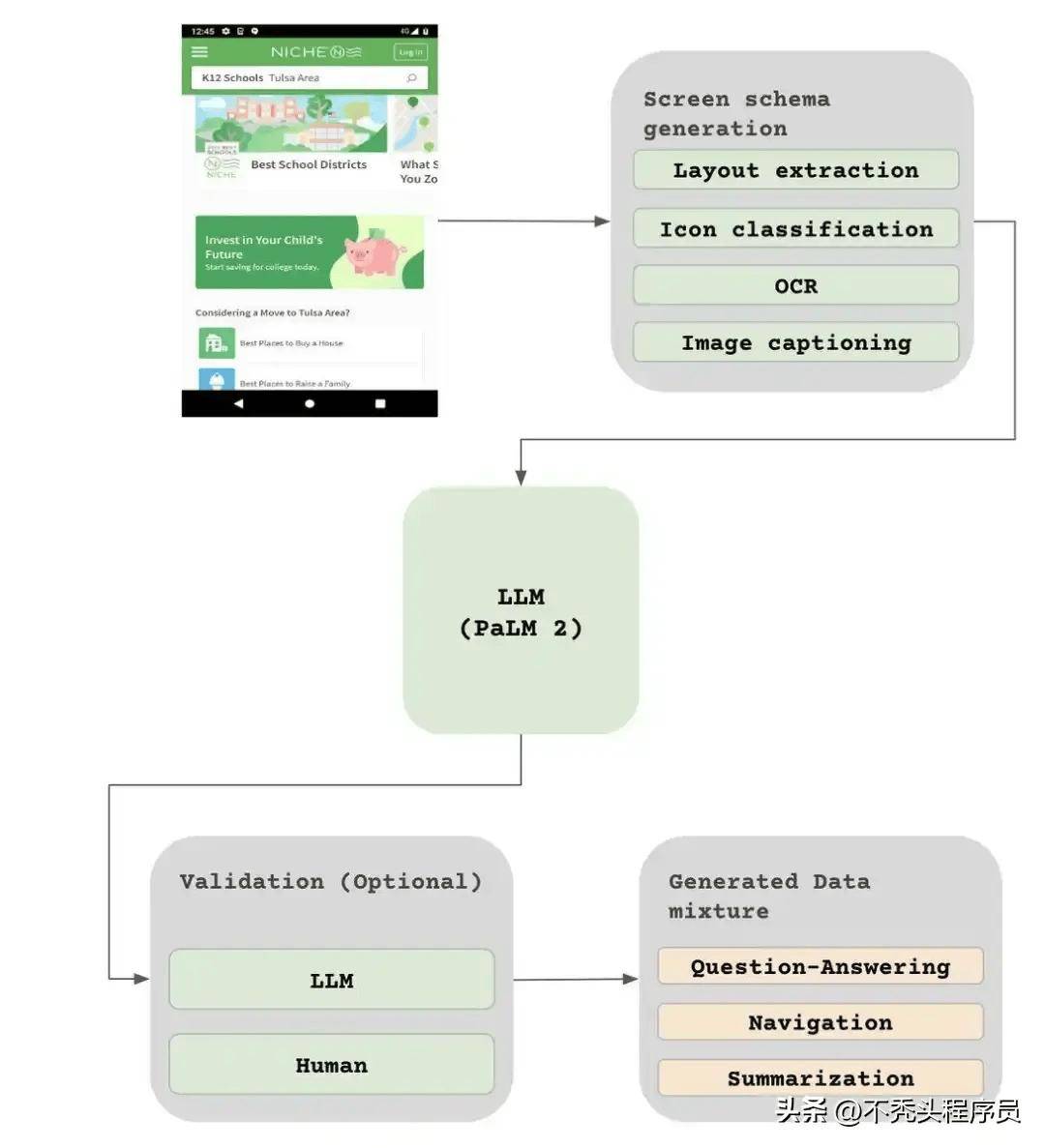

ScreenAI 在经过抓取网络,并自动与应用程序交互生成的屏幕截图数据集上进行了预训练。开发人员运用了几种现成的 AI 模型来生成合成训练数据,包含用于注释屏幕截图的 OCR 和用于生成相关屏幕截图的用户问题的 LLM。

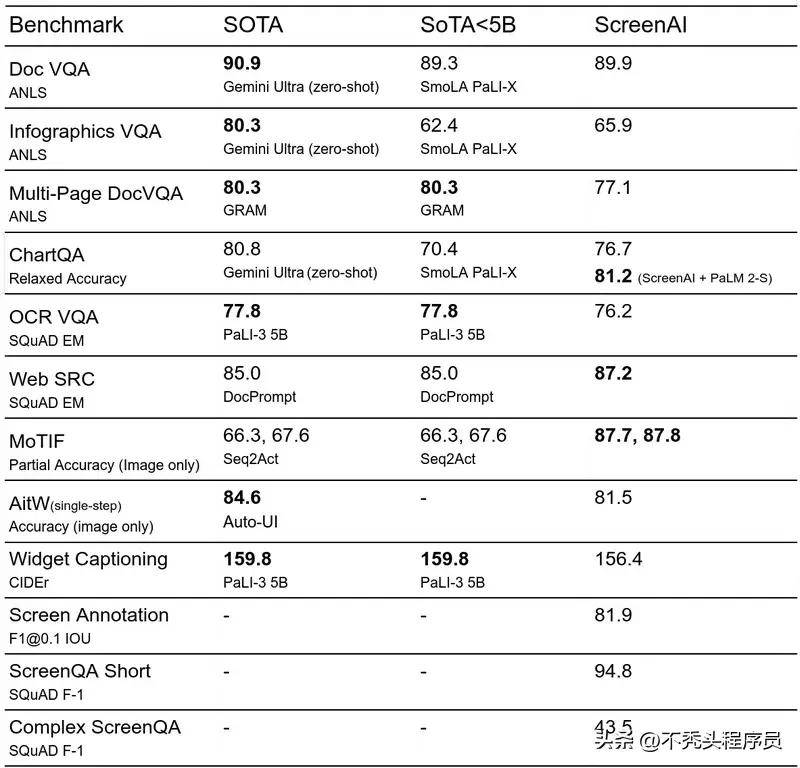

经过预训练和微调后,结果是一个 50 亿个参数模型,能够回答相关 UI 屏幕和信息图表的问题,以及总结或导航屏幕。ScreenAI 在WebSRC和MoTIF基准测试中创造了新的性能记录,并在Chart QA、DocVQA和InfographicVQA基准测试中优于其他类似体积的模型。

为了帮忙更广泛的科研社区研发和评定类似的模型,Google 发布了三个用于基于屏幕的问答 (QA) 模型的新评定数据集。

Google 这是解释的:

虽然咱们的模型是同类中最好的,但咱们重视到,在某些任务上,需要进一步科研来缩小与 GPT-4 和 Gemini 等模型的差距,这些模型要大几个数量级。

为了鼓励进一步科研,咱们发布了拥有这种统一暗示的数据集,以及其他两个数据集,以便在屏幕关联任务上对模型进行更全面的基准测试。

ScreenAI 基于 Pathways 语言和图像模型 (PaLI) 架构,该架构将视觉变换器 (ViT) 与编码器-解码器大型语言模型 (LLM)(例如 T5)相结合。

Google 团队对此基本架构进行了关键修改。因为 UI 和信息图表一般拥有“各样分辨率和纵横比”,为此她们修改了 ViT 的图像修补过程,以运用Pix2Struct模型中的修补策略。这将准许模型按照输入图像的形状调节补丁网格。

为了生成预训练数据,科研人员首要创建了一个自动注释管道。该系统在给定屏幕截图图像的状况下,能够检测和归类 UI 和信息图表元素,例如图像、象形图、文本和按钮。结果是一个屏幕架构 注释,其中列出了 UI 元素以及指示它们在屏幕内位置的边界框。

而后,屏幕模式数据用于生成合成训练数据。该团队将架构供给给法学硕士,并提示告诉法学硕士该架构表率屏幕截图,并需求法学硕士生成人类用户可能会询问的相关屏幕截图的问题。科研人员还让法学硕士生成屏幕截图的摘要。总体而言,最后数据集包括大约 4 亿个样本。

ScreenAI 的运作就像一个强大的 UI 解释器,以咱们从未想过的方式理解数字世界。它的魔力分两个周期展开:

预训练:利用自监督学习,自动生成数据标签,为其理解奠定基本。

微调:在人类评分者供给的手动标记数据的帮忙下,它将其技能完善到完美。

让咱们深入科研一下它有些令人“瞠目结舌”的功能:

1.屏幕助手

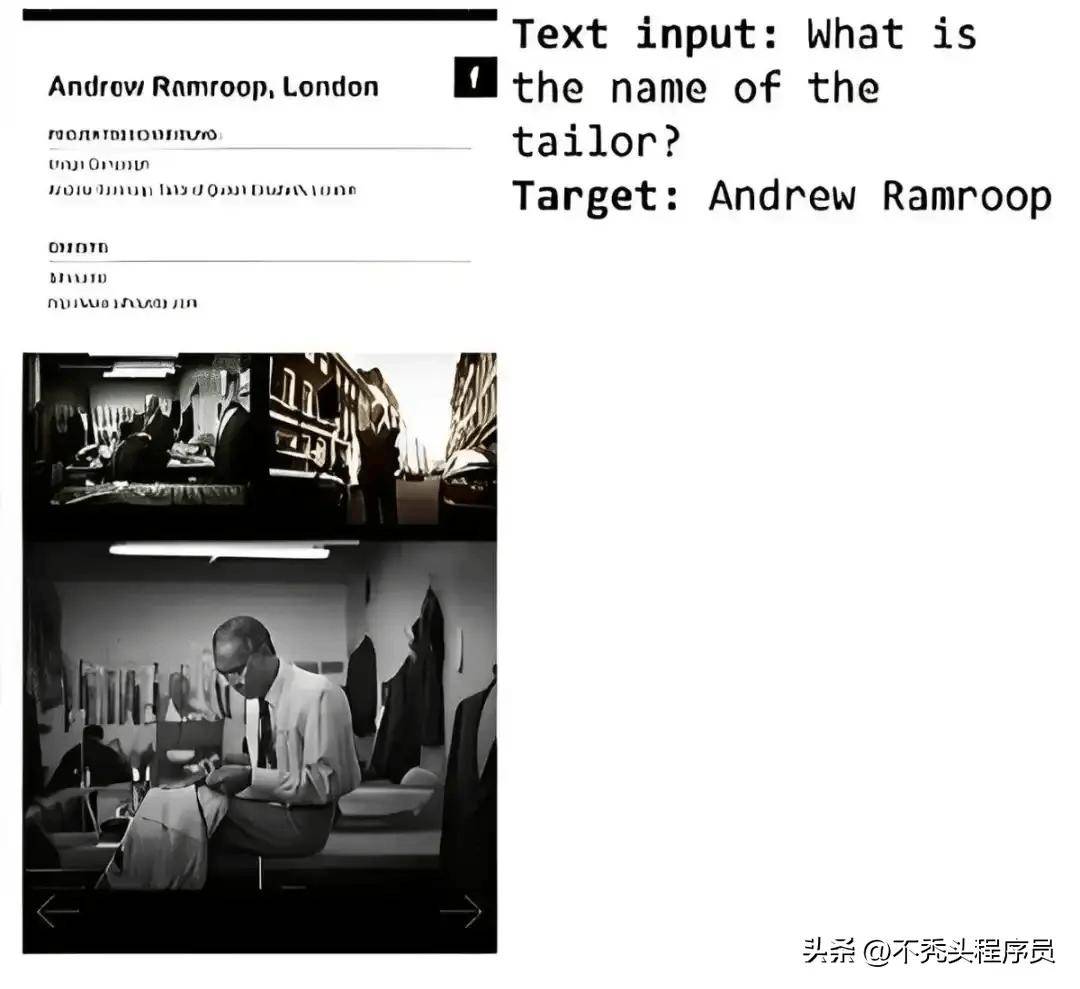

有人是不是期盼有一个人工智能助手来回答相关屏幕截图内容的所有紧迫问题?

嗯,有了 ScreenAI,这个梦想就变成为了现实。

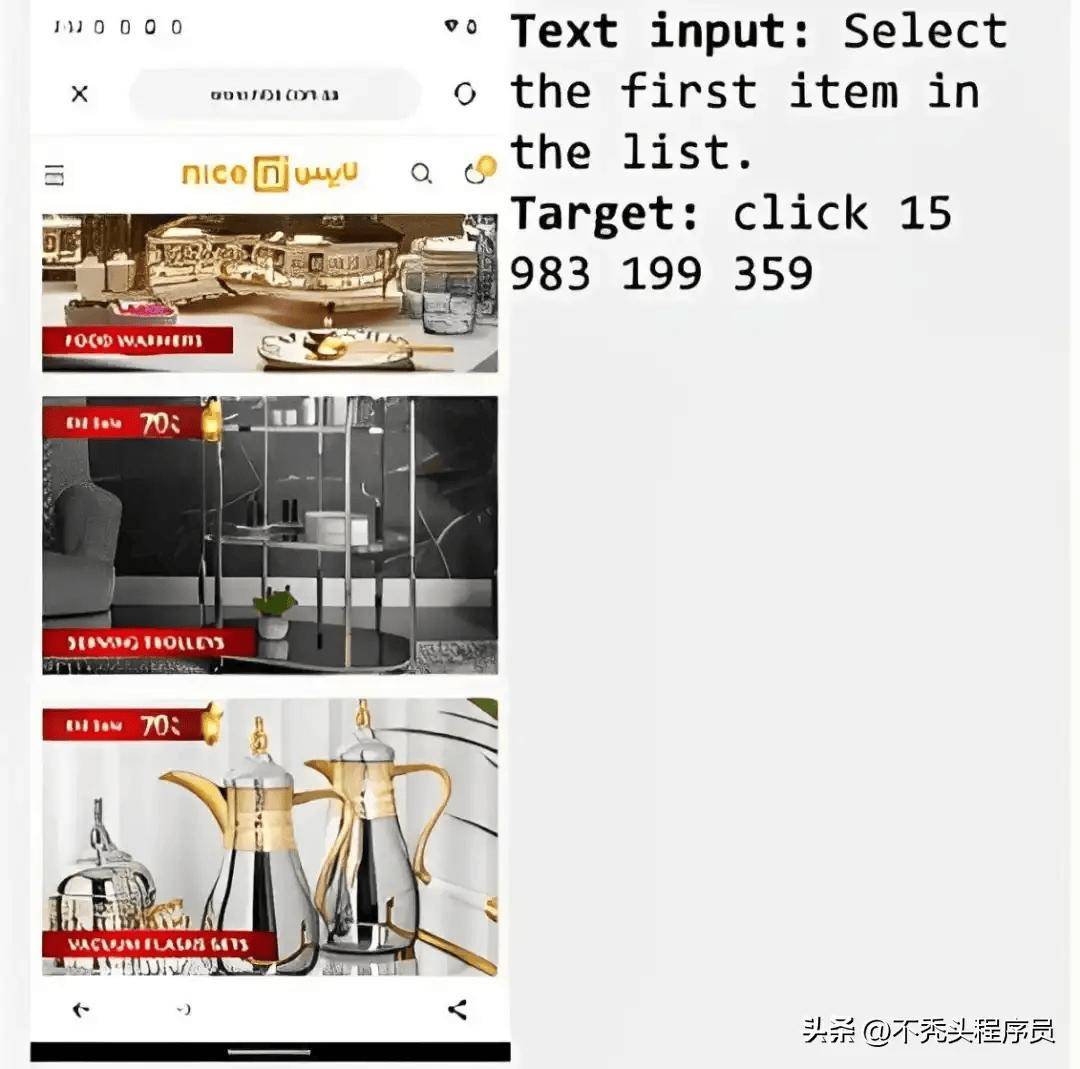

2. 屏幕导航

需要在屏幕上执行特定操作但不想动一根手指?只需告诉 ScreenAI 你需要什么,而后观看它发挥其魔力。

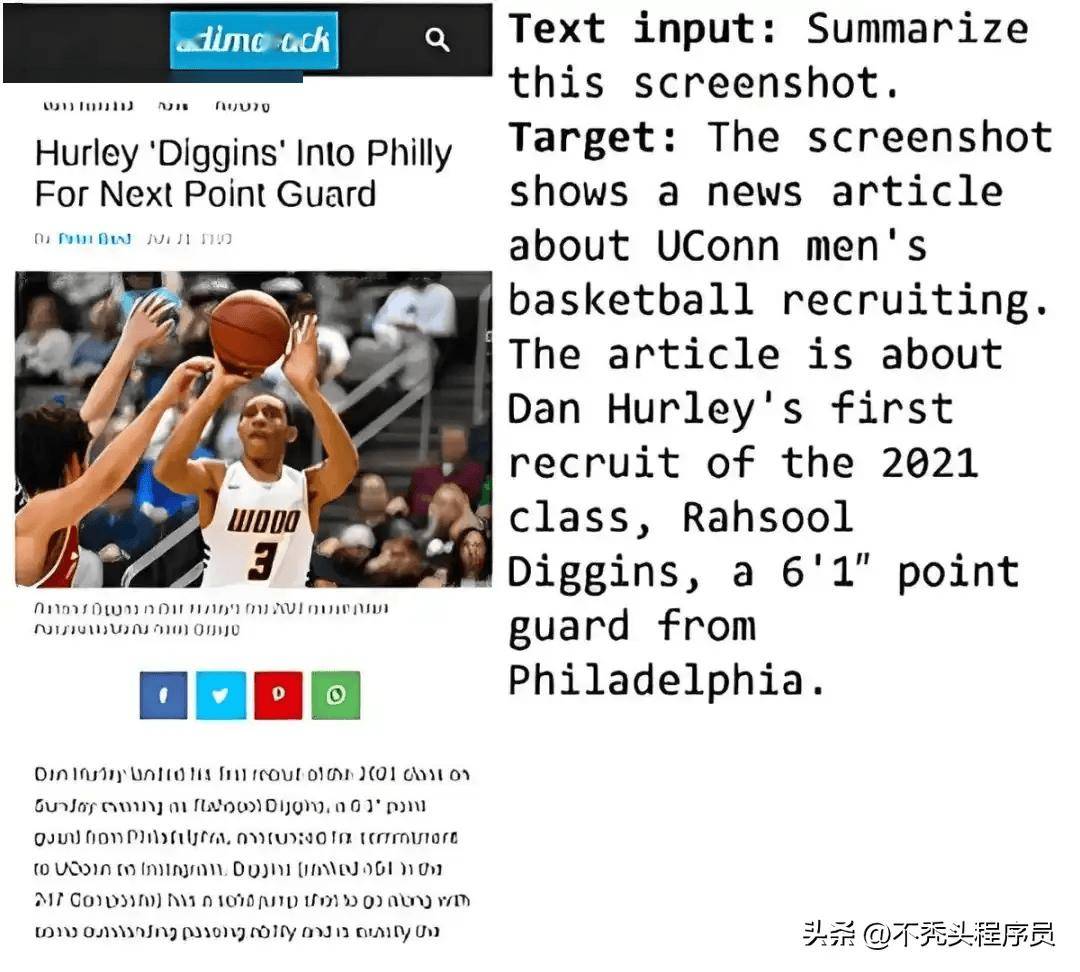

3. 屏幕摘要

煞费苦心地搜索屏幕内容的日子已然一去不复返了。ScreenAI 将其所有压缩成一口体积、易于理解的片段。

实验与结果

如前所述,ScreenAI 经历了两个关键的训练周期:预训练和微调。

在预训练时期,运用自监督设备学习技术生成数据标签,而微调则触及运用人类评定者标记的数据来完善模型的技能。

在微调周期,ScreenAI 运用各样公共 QA、摘要和导航数据集进行测试,涵盖与用户界面 (UI) 关联的广泛任务。针对问答 (QA),多模态和文档理解行业的既定基准。

可做为测试场,包含 ChartQA、DocVQA、多页 DocVQA、InfographicVQA、OCR VQA、Web SRC 和 ScreenQA。针对导航任务,采用了 Referenc Expressions、MoTIF、Mug 和 Android in the Wild 等数据集。屏幕摘要运用 Screen2Words 进行评定。

除了这些微调数据集之外,咱们还引入了三个新颖的基准来评定微调的 ScreenAI 模型:

屏幕注释:此基准测试评定模型注释布局和理解屏幕内空间关系的能力。

ScreenQA Short:ScreenQA 的变体,该基准测试的特点是缩短了真实答案,与其他 QA 任务更加紧密地结合在一块。

繁杂的 ScreenQA:此基准测试包含更具挑战性的问题,例如触及计数、算术、比较和不可回答的查找的问题。它还包含拥有各样长宽比的屏幕,以测试模型的多功能性。

经过微调的 ScreenAI 模型无让人失望。它在各样 UI 和基于信息图表的任务(包含 WebSRC 和 MoTIF)中实现了最先进的结果。另外,与类似体积的模型相比,它在 Chart QA、DocVQA 和 InfographicVQA 上表现出一流的性能。ScreenAI 还在 Screen2Words 和 OCR-VQA 上展示了拥有竞争力的性能。

这些结果强调了 ScreenAI 在应对各样 UI 关联挑战方面的功效和多功能性。另外,新基准数据集的引入为将来的科研奠定了基线,为该行业的进一步发展铺平了道路。

在 ScreenAI 的引领下,经过人工智能驱动的创新来加强用户体验的可能性将是无限的。

日前,Google 尚未发布模型代码或权重,但她们已在 GitHub 上开源了评定数据集ScreenQA和Screen Annotation 。

结论:下一步是什么?

此刻,你可能巴望把握 ScreenAI 并彻底改变你的 UX 游戏。但别着急——黄金时段还无完全准备好。到日前为止,它仍然是谷歌策划者手中的一个尖端科研项目。

但不要害怕,由于将来看起来是光明的。在谷歌的引领下,ScreenAI 从一个诱人的概念转变为现实世界的游戏规则改变者只是时间问题。

因此请继续关注,小伙伴们。ScreenAI 的时代已然来临,这将是一场新的革命。

关联参考:

https://github.com/google-research-datasets/screen_qa

https://github.com/google-research-datasets/screen_annotation返回外链论坛:www.fok120.com,查看更加多

责任编辑:网友投稿

|