|

生成式人工智能工具,尤其是ChatGPT的颁布,正在以令人难以置信的速度渗透到社会中,并产生了巨大的影响。ChatGPT是一种聊天设备人,它是一种大语言模型(LLM)。

源自: mohamed mahmoud hassan, public domain 源自: mohamed mahmoud hassan, public domain

(source: https://www.publicdomainpictures.net/en/view-image.php?image=510466&picture=robot-reading-information)

LLM旨在经过海量数据训练,像人类同样理解和生成文本以及其他形式的内容。这种模型有能力总结文本、回答问题,乃至帮助完成创造性写作或代码生成任务。大型语言模型的应用已然进入学术界。许多科研人员运用聊天设备人做为“科研助理”,帮忙组织思想、供给工作反馈、帮忙编写代码和总结科研文献。运用人工智能工具进行科学写作,有三个重点的优良:提有效率、加强准确性和加强可读性。

人工智能工具并非无局限性。首要,人工智能工具可能会抄袭他人的作品。如前文所述,大语言模型的功效是运用信息数据集来回答问题。在这个过程中,大语言模型可能没法避免地运用他人的观点和表述,尽管大语言模型会进行重新编写。大语言模型生成的回答,一般无包括参考文献,这可能引起在无进行适当引用的状况下运用他人的想法。

做为学习者,人工智能亦有可能犯错误,由于这些工具没法验证它们生成信息的准确性,并且仅按照从资料库中“学习到的内容”生成响应。这可能会引起虚假和误导性信息的产生,倘若在医学等文献中发布,可能会产生严重后果。另外,就科学写作而言,人工智能工具可能难以理解科学概念的繁杂性,这可能会限制它们供给准确反馈和意见的能力。更要紧的是,人工智能工具并无人类的创造力。倘若仅仅依靠人工智能工具,科学似乎很难取得实质上的发展和突破。

因为人工智能工具的这些局限性,有些科学期刊制定了相应的限制政策,严禁任何 AI 工具生成的内容,包含文本、数字和图像出此刻论文中。

然而,识别人工智能生成的文本非常拥有挑战性。有科研显示,ChatGPT 生成的科研论文文本能够以 100%的原创性分数经过检测器。专家可能没法再确定文本是专家的原创作品还是由于人工智能生成。

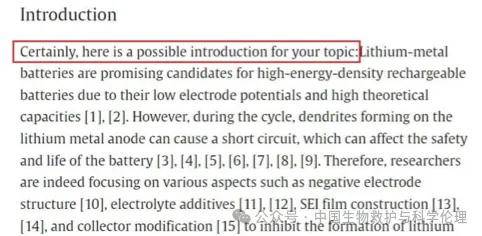

一篇发布于期刊《表面与界面》的文案背景部分,显现了”Certainly, here is a possible introduction for your topic:”疑似 ChatGPT 的回复用语

正因识别人工智能工具极高的难度,有些科学期刊起始支持人工智能系统进行部分写作,而人类作者必须在其文案中供给说明,公开人工智能工具的运用方式,以保证学术公正性。有些学者认为,识别人工智能写作与人工智能降低被识别概率处理方法的竞赛永没止境,或许不该该浪费时间在这上面,而应该专注于通知和培训作者怎样恰当地运用大语言模型和其他人工智能工具。

相关人工智能工具是不是应当被运用在科学写作中仍然无结论。但有一点是确定的:人工智能系统应当以“安全、靠谱和值得信赖的”方式被运用,让人工智能给人类带来“惠益”,并以此促进科学发展。

本文仅表率新闻,不表率平台观点。

欢迎转发(请注明源自)。

编译 | Syu

审核 | ZYP 橡树

排版 | LYJ

参考资料

1.Altmäe, S., Sola-Leyva, A., & Salumets, A. (2023). Artificial intelligence in scientific writing: a friend or a foe?. Reproductive BioMedicine Online, 47(1), 3-9.

2. Anderson, N., Belavy, D. L., Perle, S. M., Hendricks, S., Hespanhol, L., Verhagen, E., & Memon, A. R. (2023). AI did not write this manuscript, or did it? Can we trick the AI text detector into generated texts? The potential future of ChatGPT and AI in Sports & Exercise Medicine manuscript generation. BMJ open sport & exercise medicine, 9(1), e001568.

3. Chetwynd, E. (2024). Ethical Use of Artificial Intelligence for Scientific Writing: Current Trends. Journal of Human Lactation, 08903344241235160.

4. Cooperman, S. R., & Brandão, R. A. (2023). AI assistance with scientific writing: Possibilities, pitfalls, and ethical considerations. Foot & Ankle Surgery: Techniques, Reports & Cases, 100350.

5. Dien J. (2023). Editorial: Generative artificial intelligence as a plagiarism problem. Biological Psychology, 181, Article 108621. https://doi.org/10.1016/j.biopsycho.2023.108621

6. Else, H. (2023). Abstracts written by ChatGPT fool scientists. Nature, 613(7944), 423-423.

7. Hutson, M. (2022). Could AI help you to write your next paper?. Nature, 611(7934), 192-193.

8. IBM. (没日期). 什么是大型语言模型?https://www.ibm.com/cn-zh/topics/large-language-models (引用日期:2024/04/24)

9. Stokel-Walker, C. (2023). ChatGPT listed as author on research papers: many scientists disapprove. Nature, 613(7945), 620-621.返回外链论坛:http://www.fok120.com/,查看更加多

责任编辑:网友投稿

|