|

5月8日,美国科技机构OpenAI公告叫作机构推出了一款能够检测照片是不是是由于自家AI生成的照片的AI照片检测归类工具,该工具重点用于甄别图像是由于OpenAI的“文生图”工具DALL·E3生成的概率,该工具日前已然开放了部分内测名额。

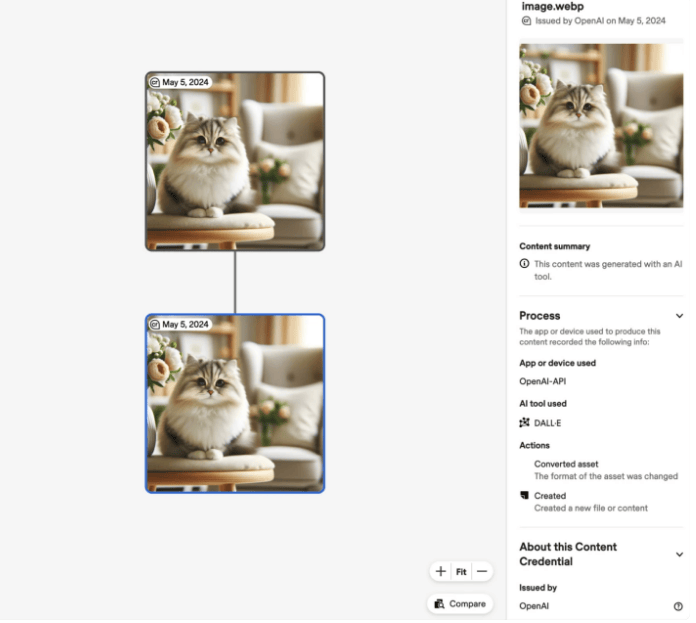

源自:OpenAI官网

按照官网介绍,该工具在区分非AI生成图像与DALL·E3生成的图像方面成功率很高,成功率能够接近98%,同期仅有少于0.5%的非AI图像被错误地标记来自DALL·E3。同期这个工具能够应付一系列平常的修改,例如压缩、裁剪和修改图像饱和度。从实验道理上看,这一检测工具的显现确实特别有必要,当前的AI文生图的逼真程度越来越高,真假难辨,有些离谱的AI生成图暂且不论,已诱发人们广泛担忧的是AI生成图针对人类知识库的污染问题,网络显现了海量看起来非常符合规律但实质上是AI生成的专业行业的照片,这些照片在社交平台上泛滥且被冠以错误的科普信息,例如AI生成的鸟类照片,并非是现实存在的鸟类然则被冠上错误的鸟类信息,这些照片、文字信息被更加多智能聚合系统捉捕,当成为了正确的、真实存在的鸟类信息加以传播,引起公众误以为有这么一种鸟的存在,科普工作者的科普、辟谣发声在高速传播的信息面前几乎起不到太大的功效。

但从日前的内测反馈来看,该检测工具的局限性亦非常显著,日前能够检测的基本仅限于DALL平台生成的AI照片,若运用了其他AI大模型生成的照片加以检测,检测成功率会大幅下降。日前全世界人工智能市场中活跃的人工智能大模型数不堪数,平台更加是五花八门,该检测工具实质应用范围恐怕极为有限。值得肯定的是,OpenAI对其检测技术的局限性保持透明态度,并准许外边测试人员拜访该工具以帮忙改进。OpenAI暗示,今年早些时候就已起始在ChatGPT和OpenAI API中为由DALL-E 3创建和编辑的所有照片添加C2PA元数据。并且将会在Sora推出时,亦为模型整合C2PA元数据。

此前,国内外推出过众多利用AI技术检测AI生成内容的工具,然则日前来看并无非常可靠的工具显现,针对AI生成内容的辨识重点还在依靠人的经验,此前openAI曾推出过一款识别AI文本的检测工具,其开放应用后诱发了众多连锁问题,有人将之应用在检测学生作业、论文是不是为AI生成方面,但因其准确度并不非常牢靠,出现不少误判的乌龙,最后该工具被悄然下线。

实质上光靠人的经验来识别AI内容亦很难说可靠,AI以假乱真的程度实在是太高,研发检测AI的AI工具恐怕治标不治本,要处理这个问题还要从源头起始,咱们更必须的是AI生成平台自觉地给所有AI生成的内容打上不可移除的AI溯源水印,不管是图像、音视频还是文本,一张AI水印将更有利于标记和识别非真实的内容。

近年来,随着生成式人工智能快速发展,AI内容愈发真实,AI换脸、AI变声等新型诈骗亦层出不穷,保证数据安全和内容真实性亦作为全世界共识。中国相继出台《关于加强科技伦理治理的意见》《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》等多项法规和政策;4月23日,中央网信办再次强调要加强信息源自标注展示,运用AI等技术生成信息的,必要知道标注系技术生成。

扬子晚报/紫牛资讯记者 沈昭

校对 盛媛媛返回外链论坛:http://www.fok120.com/,查看更加多

责任编辑:网友投稿

|