|

编注:咱们会不定时挑选 Matrix 的优秀文案,展示来自用户的最真实的体验和观点。文案表率作者个人观点,少许派仅对标题和排版略作修改。

北京时间 5 月 14 日凌晨一点,OpenAI 在线上直播了 Spring Update(春季更新),特意选取在谷歌年度 I/O 大会的前一天举行,吊足了各路媒介和网友的胃口。

那样,GPT-4o 到底更新了什么?OpenAI 是不是保住了自己在大模型行业的绝对话语权?为何网友看完演示后纷纷感叹「你大爷还是你大爷」?

我在一天的时间里密集阅读了各路媒介、博主、公司以及来自 OpenAI 官方的宣传视频、诠释分析和实测体验,本文就来一文讲清堪叫作「科技界小春晚」的这次 OpenAI Spring Update。

发布会前:放料预热,辟谣捉内鬼

▍4 月 30 日:奥秘模型登场

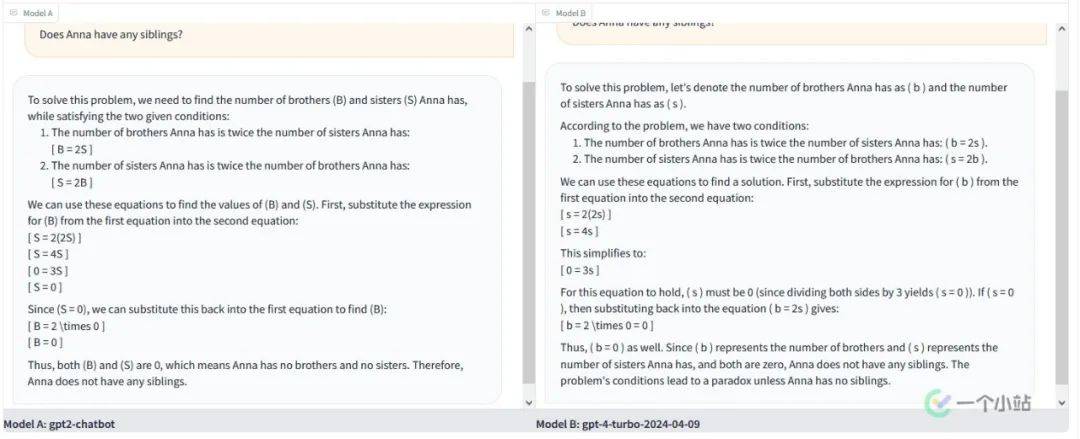

4 月 30 日,一个名为 gpt2-chatbot 的大模型悄然出此刻大模型竞技场 LMSYS 上。尽管基准测试分数未被公开,但按照网友的实测,其性能超越了日前市面上的所有大语言模型。经过提示词引导和基于 token 分词器的科研发掘,gpt2-chatbot 很可能来自 OpenAI,且应该是 GPT-4 的改进版本。其在规律能力、代码能力和数学能力上具备当今其他任何大模型没法比拟的优良。

网上广泛流传的对该奥秘模型的分析指出:「很可能,这个奥秘模型实质上是 GPT-4.5,做为一个『渐进式』模型更新的实例发布」。该模型的结构化回复似乎受到了修改后的 CoT(思维链)等技术的剧烈影响。输出的整体质量 —— 尤其是其格式、结构和理解能力 —— 绝对是一流的。多位在 LLM 提示和聊天设备人方面经验丰富的人士(在公开和暗里场合)都重视到输出质量出乎意料地好。

「对我来讲,感觉就像是从 GPT-3.5 到 GPT-4 的飞跃,但这次是以 GPT-4 为起点。」

▍5 月初:LMSYS 的操作和 Sam Altman 的回复

随着各路媒介纷纷报告,LMSYS 悄悄删除了该模型,并更新了运用政策,知道商场机构能够以「匿名发布」的方式将新模型供给给 LMSYS 平台供公众测试。LMSYS 会将反馈结果和部分样本供给给模型供给方,且模型供给方有随时撤回模型的权利。不久后,LMSYS 以 im-a-good-gpt2-chatbot 和 im-also-a-good-gpt2-chatbot 的模型名,重新上线了这一奥秘模型的两个微小区别的变种。

与此同期,OpenAI 首席执行官 Sam Altman 在哈佛大学演讲中向所有人确认,gpt2-chatbot 不是 OpenAI 的「下一代大模型」(即传闻的 GPT-5)。

▍5 月中旬:发布会前的舆论风波

时间来到 5 月,OpenAI 近期对其官网进行了更新,网友发掘 OpenAI 的域名显现了五十余个新的子域名,其中最受关注的是 search.chatgpt.com。媒介报告指出,OpenAI 始终在研发一款网络搜索制品,并分析叫作这将加剧与 Google 的竞争。该搜索服务将部分由 Bing 供给支持。

据外电援引信息人士 Jimmy Apples 透露,OpenAI 可能火速就会推出一款新的搜索引擎,并暗示该机构计划在本月举办一场活动,暂定于 2024 年 5 月 9 日上午 10 点。知情人士还透露,OpenAI 从 1 月初起始就在招聘活动团队,负责组织内部活动。5 月 10 日,路透社报告叫作,OpenAI 可能会安排在谷歌年度 I/O 大会前一天发布搜索制品。

5 月 11 日,OpenAI 宣布将于美国时间 5 月 13 日上午 10 点(北京时间 5 月 14 日凌晨 1 点)在其官网上直播,展示最新的 ChatGPT 及 GPT-4 关联更新。

与此同期,OpenAI 首席执行官山姆・阿特曼驳斥了路透社的一篇报告,叫作 OpenAI 将于下周一推出一款搜索制品。阿特曼在 X 上发帖叫作,虽然 OpenAI 定于周一早上发布公告,但 「不是 GPT-5,不是搜索引擎」,但无论它是什么,他说它 「感觉就像魔术同样」。OpenAI 官方帖子供给的独一细节是,此次发布将更新 ChatGPT 及其最新模型 GPT-4。

随后有网友爆料,所说「搜索制品」是 OpenAI 投出的诱饵,目的是揪出内部泄密者。而经常给 Jimmy Apples 和 Flowers 泄密的爆料人,已然被 OpenAI 解雇。

而 Information 则报告叫作,OpenAI 正在研发一个全能的 AI 语音助手,预计在下周展示。这项新技术能够经过声音和文本与人交流,能够识别区别人的语调、语气,并能识别物体和图像。

▍谜底揭晓

直到发布会后,咱们才从 OpenAI 官方人员的推文中得知,im-also-a-good-gpt2-chatbot 已被正式确认为 GPT-4o。她们声叫作,「这不仅是世界上最好的模型,况且可以避免费在 ChatGPT 中运用,这在前沿模型中是前所未有的。」 据叫作,该模型部分是应用 Q-learning 和 A* 搜索(Q*)的产物。

另外,LMSYS 确认,所有 gpt2-chatbots 都来自 OpenAI,且在内部排行榜上名列前茅,拥有非常类似的 Arena ELO、置信区间、编码结果、胜率等。

GPT-4o:人人可用的顶级端到端多模态大模型

在发布会中,OpenAI 暗示,期盼把最强大的 AI 工具免费供给给所有人运用,将来每一个人或将持有像 GPT-7 这般的 AI 算力。

这次发布会展现了 OpenAI 工科人的直率气质,一起始就把整场发布会的要点放在了背面的 Slides 上,核心便是 「人人都能用上」 的 GPT-4o 模型。

GPT-4o 是 OpenAI 继 GPT-4 后推出的全新基本模型,o 代表 omni,即 「全能」,表现了模型在多模态等方面的全面升级。

GPT-4o 最大的亮点是支持多模态输入输出,能够接受和生成文本、语音、图像的任意组合,使人机交互更加自然流畅。语音响应速度大幅提高,可在 232 毫秒内给出回复,接近人类水平。

在性能方面,GPT-4o 在英语文本和编程方面与 GPT-4 turbo 相当,但在非英语文本、视觉、语音理解等方面有明显提高。同期,推理速度更快,API 价格降低 50%。

▍基准测试:刷新记录

在多个基准测试中,GPT-4o 刷新了之前模型的最好成绩。按照 OpenAI 官方发布的数据,GPT-4o 在 MMLU(语言理解能力评测)上得分 88.7,为综合模型最高分;在 MATH 数学推理上较此前最好模型(Claude3-Opus)提高 27.5%;在 HumanEval 编程评测中达 90.5 分,亦是最高水平。

GPT-4o 文字能力基准测试结果 图 / OpenAI

▍中文能力:超越前代

5 月 14 日下午,国内致力于大模型中文推理能力的第三方测评公司 SuperCLUE 亦颁布了 GPT-4o 的中文能力评测结果:

GPT-4o 中文推理能力排名 图 / SuperCLUE 在完成 SuperCLUE 推理任务时,GPT-4o 的整体得分为 81.73,超过 GPT-4 Turbo 作为中文推理任务最强模型。

GPT-4o 在 SC-Math6 数学基准上得分 91.77 分,较 GPT-4 Turbo 提高 1.06 分,登顶 SC-Math6 榜首,判定为推理等级 5。GPT-4o 在 SC-Code3 代码基准上得分 71.68 分,较 GPT-4 Turbo 提高 2.11 分,刷新 SC-Code3 最好成绩。

多模态能力:语音助手的「下一个十年」

在发布会上,GPT-4o 的多模态能力作为展示的重点。演示中,语音助手和视频通话功能尤为令人惊叹:属于语音助手的「下一个十年」,似乎真的要来了。

按照 OpenAI 对 GPT-4o 模型的官方介绍,GPT-4o 是一个端到端的真正多模态大模型,能够接受文字、视觉(照片 / 视频)以及听觉(音频)三种类型的输入,并可输出这三者的任意组合。亦便是说,原先必须 Whisper(OpenAI 发布的语音转文字模型)、GPT、TTS 三个模型逐一工作才可实现的语音助手功能,此刻不仅能够由一个模型处理,乃至还支持了视频的输入。

端到端的多模态模型并不是鲜嫩事。曾经 Google 推出的 Gemini 模型就为咱们供给了端到端多模态的例子。

不晓得大众还记不记得,Gemini 发布时的演示视频,能够按照视频的输入做出分析和回复,这在当时令不少网友感到振奋。

Gemini 的多模态能力演示视频,后被证实有剪辑

然而,Gemini 最后未能掀起太大的波涛,其演示视频亦因破绽百出而被质疑。官方不得不承认视频中有加速和拼接的成份,乃至还必须人类提示词辅助,Gemini 才可按照视频输入做出符合需求的判断。

OpenAI 显然吸取了前人的教训。在发布 GPT-4o 的页面上,特地标注了「All videos on this page are at 1x real time.」,这亦表示了 OpenAI 对其模型能力的自信心。

尽管咱们日前还不可马上体验到 GPT-4o 的语音和视频对话功能,但从现场官方的演示来看,GPT-4o 的多模态效果已然足够惊艳。

首要是情感表达。GPT-4o 因为是端到端的多模态大模型,省去了语音文字互转的过程,相比传统的文字生成模型,能够直接捉捕到音视频中难以用文字表达的信息,例如人的表情、语气、环境音、以及说话人的身份。

从前的 ChatGPT 语音对话,软件会运用 Whisper 模型在用户停顿时,将音频发送给模型进行识别,而 Whisper 的能力则仅仅是将音频转化为类似字幕的形式。即使调用 Whisper 的所有能力,亦仅能区分大致的说话人,并识别歌声、掌声等音效。

在输出方面,从前的传统 TTS 模型输出的语音都是固定的,模型(或说程序)本身并不具备理解文字内容的能力,分析情感更加是无从谈起。直到 SSML(语音合成标记语言)的显现,人们(或大模型)能够经过在输入的文本中添加对语气和断句的标记,指点语音合成程序生成包括区别「情感」的声音。但这本质上亦是预编程的结果,在无标记提示的状况下,无 TTS 模型能够理解自己朗读内容的情感。这亦解释了去年 OpenAI 的 TTS 模型发布时,因其对人类语气、卡壳等细微动作的模仿,而一度被网友盛赞。

而 GPT-4o 的情感能力,则是在输入和输出两端都能完美展现。除了捉捕音视频中难以用文字表达的信息,GPT-4o 输出的语音亦再也不仅仅是冰冷的文本和固定情感语调的组合,而是真正地将每一个字节的输出都交由大模型本身。例如,在语音对话时,GPT-4o 实质上是在进行音频到音频的输出,中间不必须转换到文字的思考过程,因此呢大模型具备了能听能说的情感能力。

更令人惊叹的是,GPT-4o 是一个支持三种输入类型的多模态模型。在发布会上,咱们看到,当 GPT-4o「看到」人类在纸上写着的「I ❤️ ChatGPT」的文字后,居然会作出感动的回复。这儿触及到的是音频和视频到音频的多模态情感能力。

亦难怪有人说,《流浪地球》里的 MOSS 和科幻电影《Her》里的语音助手,都被 GPT-4o 带到了现实。

分词器更新:更懂多语言,更省 Token

GPT-4o 的推出还伴同着分词器的更新,这一更新明显提高了多语言处理能力,同期大幅减少了 Token 的运用量。

按照 OpenAI 的数据,新的分词器在多种语言上的表现都非常出色。例如,Gujarati 语言的 Token 数量减少了 4.4 倍,从 145 个减少到 33 个;Telugu 语言减少了 3.5 倍,从 159 个减少到 45 个;乃至针对相对繁杂的中文,Token 数量亦减少了 40%,从 34 个减少到 24 个。

从当前网友的分析来看,新的分词器名为「o200k_base」,包括了更加多的词汇,从而明显压缩区别语言的 Token 数量。

分词器的更新亦是 GPT-4o 生成速度更快的原由。哪怕在算力和模型规模不变的状况下,经过减少 Token 数量(如一个 Token 包含更加多字符,例如中文的成语、俗语等),拥护亦能感知到显著的生成速度提示。更何况在当前调用 API 的体验来看,GPT-4o 模型每秒生成的 Tokens 数量亦有显著提高。

OCR 能力更新:能看懂中文,更能看懂题

在 GPT-4o 的更新中,OCR(光学字符识别)能力亦得到了明显提高。新模型不仅能够更准确地识别和理解中文文本,还在理解繁杂的图表和题目上表现得更加出色。

我分别运用中英板书、中文海报等平常 OCR 识别场景进行了测试,实测发掘,GPT-4o 对多语言(包含中文、日语)的 OCR 能力有了明显进步,日前已然基本达到可用水准。

能够期待一下,当视频通话功能推送以后,中文用户应该亦能够体验到 GPT-4o 的绝大都数能力。

更令人振奋的是,GPT-4o 因为数学和编程基本推理能力的明显提高,此刻针对公式 OCR 后解题的成功率亦大幅提高。加上视频对话功能,20 美元一月就能请到顶级家教,岂不美哉。

▍ChatGPT 制品更新:第1手体验

GPT-4o 推送弹窗

5 月 14 日凌晨一点,OpenAI Spring Update 线上发布会如期举行。早上八点,我发掘,免费版的 ChatGPT 已然收到了最新的 GPT-4o 推送。

在左上角的模型切换页面,原先的「GPT-3.5」和「GPT-4」选项被「ChatGPT」和「ChatGPT Plus」取代。亦便是说,收到 GPT-4o 推送的免费版用户,新建对话时已然默认运用 GPT-4o 模型了。当免费的 GPT-4o 配额用尽时,会自动切换至 GPT-3.5 模型,此后没法进行对文档和照片的对话,亦无法运用 GPTs、联网和数据分析等功能。

到了晌午,我的 Plus 账号和 Team 账号亦持续收到了 GPT-4o 模型的推送。在 Plus 和 Team 的界面中,OpenAI 保存了 GPT-4 模型,供给「GPT-4o」「GPT-4」和「GPT-3.5」三种模型供付花费户自由选取。

不久后,我亦收到了发布会上提及的 ChatGPT 网页版新 UI Juice 的推送。

ChatGPT 网页版新 UI Juice

初步观察,新 UI 整体更加圆润、简洁。在每一条回复的下方新增了切换模型的选项,用户能够自由选取区别模型重新生成该对话。同期,用户提问以对话气泡展示,明显了对话感。

至于官方发布会中提及的 macOS 客户端和其他新功能,截止发稿时仍在白名单灰度周期。让咱们期待正式上线的样子吧。

我经过实测发掘,日前网页版的 ChatGPT 还不具备 GPT-4o 模型的所有多模态能力,包含对音视频的读取、生成以及对文档中照片的读取。

另外,我经过对区别等级账号的模型请求抓包发掘,针对免费账户,GPT-4o 模型的 Tokens 上下文窗口仍然和 GPT-3.5 相同,为 8192(8k),而 Plus 会员和 Team 团队版则均为 32768(32k),这与此前的 GPT-4(All Tools)模型的上下文限制相同。

受限于网页版的请求上下文限制,能够预见,免费版用户所体验到的 GPT-4o 模型将会有 「降智」 表现。而哪怕是付费会员,在网页版的 ChatGPT 中进行对话时仍然采用滑动上下文窗口,而非 128k 的模型理论最大上下文窗口。在阅读大型文档时,模型仍然只能获取开头部分内容,后续内容必须模型运用内置工具进行文中搜索获取,阅读长文的体验特别有可能与当前不会有较显著差异,乃至可能不如以长上下文窗口著叫作的 Claude 和国内的 Kimi。

大戏到来前的半代升级

从 4 月底奥秘模型 gpt2-chatbot 的揭发,到 5 月中旬 GPT-4o 的正式发布,OpenAI 的这次春季更新无疑再次激起了人们对大模型,或说对 OpenAI 本身的讨论激情。

然而,按照市场广泛预测,OpenAI 今年的 「大招」 远不止于此。其 「下一代」 模型 GPT-5 已然基本完成训练,不久前起始进入红队安全测试周期,预计最快会在今年年中正式发布。

阿里的通义千问,从 1.5 追赶到 2.5,才最终做到国内第1,全世界第三的成绩;百度的文心一言,从 3.5 追到 4.0,此刻看来亦稍显掉队。而 Sam Altman 却会对外宣叫作,当前已然稳坐世界大模型头把交椅的 GPT-4o 还不是 OpenAI 的 「下一代大模型」,可见 OpenAI 的野心和实力之大。想要追上,谈何容易。

我猜测,这次 OpenAI Spring Update 属于「大戏到来前的半代升级」,是夺回舆论焦点和行业话语权的例行升级。至于人们正在期待的下一代大模型「GPT-5」,就让咱们拭目以待吧。

原文链接:

https://sspai.com/post/88803?utm_source=wechat&utm_medium=social

作者:别为馒头

责编:广陵止息

/更加多热门文案/返回外链论坛:www.fok120.com,查看更加多

责任编辑:网友投稿

|